Скала! Большая модель Pu Technology идеально совместима с графическим процессором Moore's Thread.

2024/5/30 10:03:25

Вид:

Moore Threads и Dipu Technology, передовой отечественный поставщик аналитики данных, совместно выпустили захватывающее обновление: их интеллектуальный вычислительный кластер Kilocard «Kua'e» и модель крупного предприятия Dipu Deepexi v1.0 успешно завершили обучение, а работа по настройке рассуждений получила официальную сертификацию. совместимости продуктов. Дата выдачи данного сертификационного сертификата - 28 сентября 2023 г., что указывает на то, что соответствующие задачи по настройке были выполнены ранее и не были раскрыты внешнему миру.

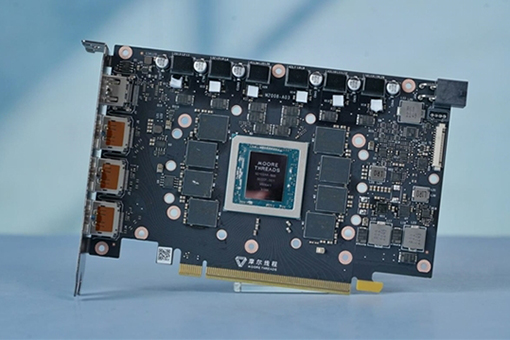

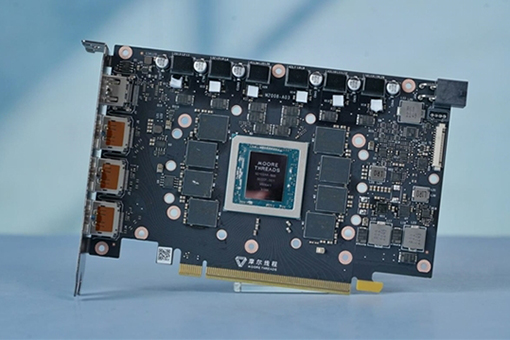

Интеллектуальный вычислительный кластер Kua'e Kilo Card компании Moore Thread не только является первым кластером в отрасли, успешно реализующим полноценную работу с домашними крупномасштабными моделями, но также основан на графическом процессоре MTT S4000 и обеспечивает покрытие модели, ускорение вывода и Совместимость с CUDA. Кроме того, интеллектуальный вычислительный кластер Kua'e Qianka имеет множество основных технологий, таких как обучение возобновлению работы точек останова, распределенное обучение и надежность кластера.

С момента своего основания в 2018 году компания Beijing Dipu Technology Co., Ltd. сосредоточила свое внимание на предоставить инфраструктуру анализа данных, крупномасштабные модельные продукты и инновационные услуги для предприятий. Ее крупномасштабная корпоративная модель Deepexi демонстрирует отличную производительность во многих областях, включая семантический анализ, визуальное распознавание, языковую обработку и кросс-модальное взаимодействие. Компания также предлагает полный набор наборов инструментов для моделей, которые помогают компаниям эффективно выполнять такие задачи, как подготовка данных, обучение моделей, настройка, развертывание и логические выводы.

Dipu Technology не только осуществила широкое сотрудничество с такими компаниями, как China Haicheng, CNNC Equipment Institute и Belle Fashion, на внутреннем рынке, но и стала лидером в продвижении внедрения крупномасштабных промышленных моделей. Мур Нид работал с Wuwen Core Dome и успешно адаптировался не только к платформе разработки и обслуживания больших моделей Wuwen Infini-AI, но также к обучению и обучению 70 миллиардов параметров LLama2 и 3 миллиардов параметров - Большой модели MT-infini-3B. завершенный.

Hanhou Group также использовала кластер интеллектуальных вычислений Moore Thread Kua'e Qianka для успешного завершения распределенного обучения крупных моделей с уровнями параметров 7B, 34B и 70B, продемонстрировав превосходную эффективность, точность и стабильность. После этой серии успехов компания Dipu Technology завершила предварительное тестирование крупномасштабной языковой модели LLaMA2 с 70 миллиардами параметров с использованием интеллектуального вычислительного кластера Moore Thread Kua'e Qianka. Весь процесс занял 77 часов и достиг ожидаемой стабильности, эффективности и совместимости.

Интеллектуальный вычислительный кластер Kua'e Kilo Card компании Moore Thread не только является первым кластером в отрасли, успешно реализующим полноценную работу с домашними крупномасштабными моделями, но также основан на графическом процессоре MTT S4000 и обеспечивает покрытие модели, ускорение вывода и Совместимость с CUDA. Кроме того, интеллектуальный вычислительный кластер Kua'e Qianka имеет множество основных технологий, таких как обучение возобновлению работы точек останова, распределенное обучение и надежность кластера.

С момента своего основания в 2018 году компания Beijing Dipu Technology Co., Ltd. сосредоточила свое внимание на предоставить инфраструктуру анализа данных, крупномасштабные модельные продукты и инновационные услуги для предприятий. Ее крупномасштабная корпоративная модель Deepexi демонстрирует отличную производительность во многих областях, включая семантический анализ, визуальное распознавание, языковую обработку и кросс-модальное взаимодействие. Компания также предлагает полный набор наборов инструментов для моделей, которые помогают компаниям эффективно выполнять такие задачи, как подготовка данных, обучение моделей, настройка, развертывание и логические выводы.

Dipu Technology не только осуществила широкое сотрудничество с такими компаниями, как China Haicheng, CNNC Equipment Institute и Belle Fashion, на внутреннем рынке, но и стала лидером в продвижении внедрения крупномасштабных промышленных моделей. Мур Нид работал с Wuwen Core Dome и успешно адаптировался не только к платформе разработки и обслуживания больших моделей Wuwen Infini-AI, но также к обучению и обучению 70 миллиардов параметров LLama2 и 3 миллиардов параметров - Большой модели MT-infini-3B. завершенный.

Hanhou Group также использовала кластер интеллектуальных вычислений Moore Thread Kua'e Qianka для успешного завершения распределенного обучения крупных моделей с уровнями параметров 7B, 34B и 70B, продемонстрировав превосходную эффективность, точность и стабильность. После этой серии успехов компания Dipu Technology завершила предварительное тестирование крупномасштабной языковой модели LLaMA2 с 70 миллиардами параметров с использованием интеллектуального вычислительного кластера Moore Thread Kua'e Qianka. Весь процесс занял 77 часов и достиг ожидаемой стабильности, эффективности и совместимости.